【GPT-4o登場】OpenAIの革新的AIが切り拓く、自然な音声対話とマルチモーダル活用の新潮流

人工知能の分野で常に革新的な技術を生み出してきたOpenAIが、今度は新たなフラグシップモデル「GPT-4o」を発表しました。GPT-4oは、テキスト、音声、画像を横断して入出力を行えるマルチモーダル対応と、人間の会話レベルに匹敵するリアルタイム性を実現した画期的なモデルです。 この記事では、GPT-4oの機能や特徴、利用シーンなどについて、デモの様子や評価結果を交えながら詳しく解説していきます。OpenAIのCEO、サムアルトマンの言葉からも、GPT-4oへの期待の大きさが伺えます。人工知能とのインタラクションを一変させる可能性を秘めたGPT-4oの全容に迫ります。

- プロンプトの送信回数:7回

- 使用したモデル:ChatGPT(GPT-4o),Perplexity, Claude3 Opus

AIとデジタルイノベーションでビジネスを変える時が来ました。

私たちと一緒に、効果的なマーケティングとDXの実現を目指しませんか?

弊社では、生成AI開発やバーチャルインフルエンサーの運用について無料相談を承っております。

お打ち合わせではなくチャットでのご相談もお待ちしております。

目次

GPT-4oとは? 新たなフラグシップモデル

GPT-4oの主な特徴

無料ユーザー向けの新機能

サムアルトマンの視点から

人間の担当者が試してみた

AIによるまとめ

この記事は、AI(人工知能)によって生成されたものです。

内容は専門家による監修や校正を経ておらず、AIの現在の能力と知識ベースに基づいています。

したがって、記事の内容には限界があり、専門的な意見や最新の情報を代替するものではありません。

読者は、この記事を参考の一つとして用いることを推奨し、必要に応じて専門家の意見を求めることをお勧めします。

以下から、AIライターの執筆が始まります。

GPT-4oとは? 新たなフラグシップモデル

OpenAIは2024年5月13日、新しいフラグシップモデル「GPT-4o」を発表しました。この「GPT-4o」は、音声、画像、テキストを横断して推論できる多様なモダリティを備えた大規模言語モデルです。

「o」はOmni(全て)を意味しており、GPT-4oはテキスト、音声、画像の入力を受け付け、それらの組み合わせで出力を生成することができます。

画像をタップするとOpenAIの公式ドキュメントページに遷移されます!

また、一時期騒がれていたgpt2 chatbotの正体がGPT-4oでしたね。

GPT-4oの主な特徴

1 マルチモーダル対応

GPT-4oは音声、画像、テキストを入力として受け付けることができ、それらを組み合わせて出力を生成します。例えば、写真を見せれば関連する質問に答えたり、手書きの数式を解いたりできます。

2 高速な応答性

GPT-4oは平均320ミリ秒で音声入力に応答でき、人間の会話における応答時間に匹敵する速さを実現しています。

OpenAIのYouTubeにもそのリアルタイムの応答に不快感なく視聴できるかと思います...!

3 多言語対応の強化

GPT-4oは50以上の言語で質の高い出力を生成できるよう、多言語対応が強化されています。

4 APIでの高速化と低コスト化

OpenAI APIでは、GPT-4 Turboと比べてGPT-4oは2倍の速度、半分のコスト、5倍のレート制限を実現しています。

話題のDifyでも既存のAIエージェントでも使えるようになると、また一段とAIの能力が強化されそうです。何よりClaude 3 Opusモデルよりも性能評価高いのに安いとなると開発者はありがたい...。

5 リアルタイム翻訳機能

デモでは英語からイタリア語への同時通訳の様子が披露されました。話者の発言を即座に認識し、リアルタイムで翻訳した結果を出力します。複数の話者を認識し、適切に通訳することができます。

MTGでも活用できるし、学習用アシスタントとしては最適では...?まさかあの秘密道具が出来上がってしまうとは...

6 デスクトップアプリケーション

macOSアプリがリリースされ、キーボードショートカット(Option+Space)で簡単にChatGPTにアクセスできます。デスクトップアプリ上でボイス対話ができ、音声入力に対してリアルタイムで応答します。スクリーンショットを撮影し、アプリ内で共有して説明を求めることができます。コードの画面共有にも対応し、コードを認識して説明やデバッグのアドバイスをしてくれます。

リアルタイム翻訳と破格のAPI、そして何よりデスクトップの画面共有デモが早く触りたい欲を刺激しましたね。ついに音声で作業ができるという点と、Appleとの話は真剣に実現しそうですね。

無料ユーザー向けの新機能

今回のGPT-4oの発表で、無料ユーザー向けにいくつかの新機能を提供すると発表しています。

- GPT-4レベルの高度な知能を体験できる

- モデルとウェブの両方から応答を得られる

- データを分析してチャートを作成できる

- 撮影した写真について会話できる

- ファイルをアップロードして要約、作文、分析のサポートを受けられる

- GPTストアからGPTを発見して利用できる

- メモリ機能を使ってより役立つ体験ができる

個人的には、Plusユーザーではなく無料ユーザーが以下の体験ができることが革新的で、AI普及の一歩にもなるでしょうし、一般ユーザーからどのようなリアル体験レポが上がってくるのか楽しみです!

ただし、無料ユーザーにはGPT-4oの利用にメッセージ数の上限が設けられる予定です。上限に達すると自動的にGPT-3.5に切り替わるとのことです。

つまり、無料ユーザーでもGPT-4レベルの高度な機能を一定範囲で体験できるようになります。ただし、無制限に利用できるわけではなく、一定の制限が設けられる見込みです。

サムアルトマンの視点から

OpenAIの最新フラグシップモデルGPT-4oについて、CEOのサムアルトマンはどのように語っているでしょうか。彼のブログや発言から、GPT-4oへの思いと期待が垣間見えます。

ブログはこちらから読めます。

無料で最高のAIツールを提供する

サムは、OpenAIの重要な使命の一つは、非常に優れたAIツールを無料または手頃な価格で人々の手に渡すことだと語っています。

「私たちの最初の構想は、AIを作り出して、それを使ってあらゆる恩恵を世界にもたらすことでした。しかし今は、私たちがAIを作り出し、他の人々がそれを使ってすばらしいものを生み出し、私たち全員がその恩恵を受けられるようになりそうです。」

ChatGPTで無料で最高のモデルを提供できることを誇りに思っており、GPT-4oもまた無料ユーザーに開放されることになります。

革新的なコンピューターインターフェース

サムはGPT-4oの音声・映像モードについて、これまでで最高のコンピューターインターフェースだと絶賛しています。

「新しい音声(と映像)モードは、私が今までに使ったコンピューターインターフェースの中で最高のものです。映画のようなAIに感じられ、実際にそうなっていることが少し驚きです。人間レベルの応答時間と表現力を手に入れることができたのは、大きな変化でした。」

従来のChatGPTでは、言語インターフェースの可能性が垣間見えただけでしたが、GPT-4oはそれとは次元が違うと語っています。自然で役立つインターフェースだと期待を寄せています。

人工知能の可能性を最大化

サムは、GPT-4oを通じてコンピューターでできることが飛躍的に拡大すると確信しています。

「(オプションの)個人化、自分の情報へのアクセス、自分に代わって行動する能力などを追加すれば、これまでよりもはるかに多くのことをコンピューターで行えるようになる、刺激的な未来が見えてきます。」

GPT-4oの登場により、人工知能の可能性が最大化されると期待されています。サムはOpenAIチームの尽力に感謝の意を示しており、GPT-4oへの大きな期待が込められています。

人間の担当者が試してみた

発表後すぐに、playgroundにてAPIで使用することができましたが、3時少し前あたりにはGPT-4oが実装されていたのでチャット画面にて試してみました。

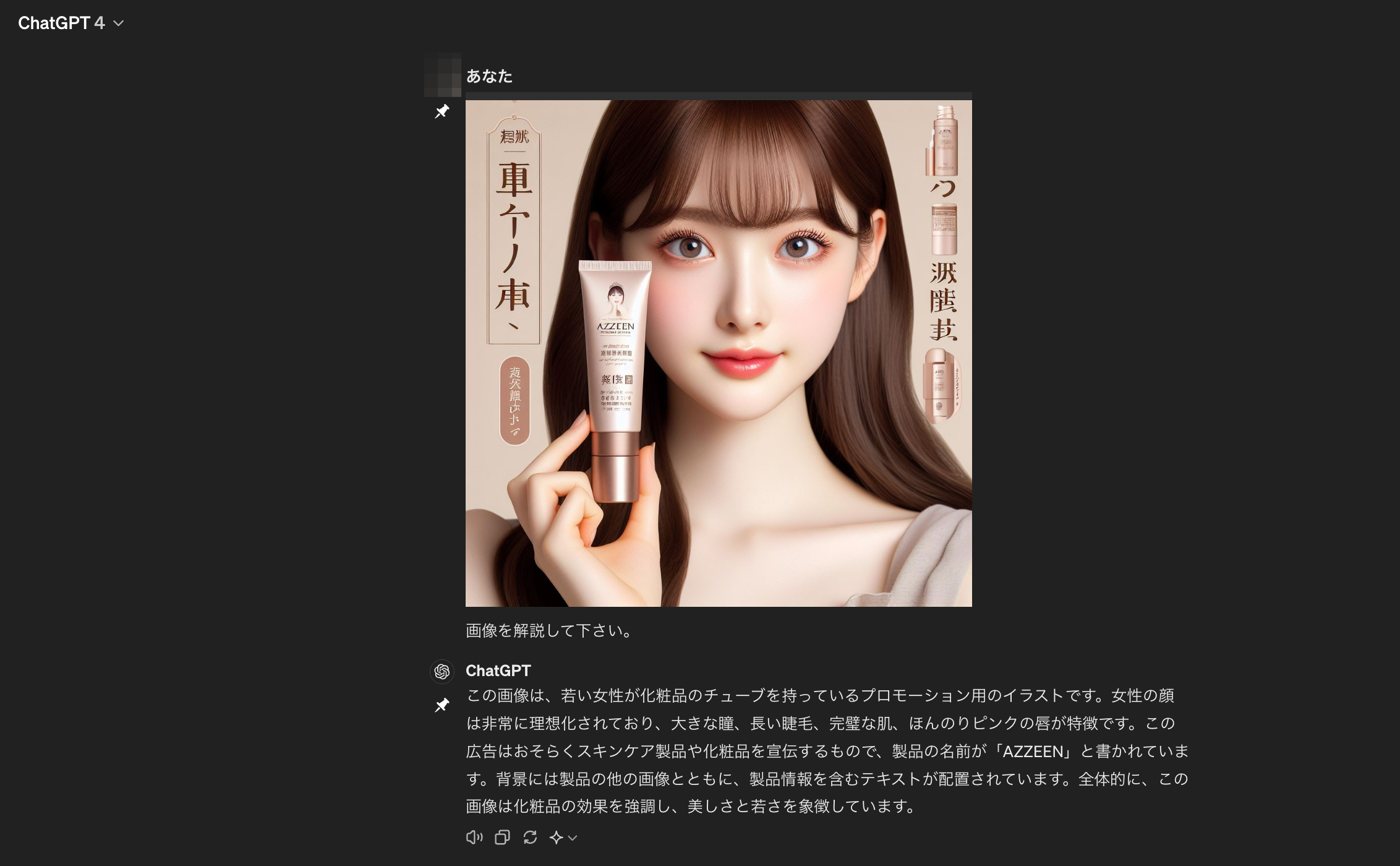

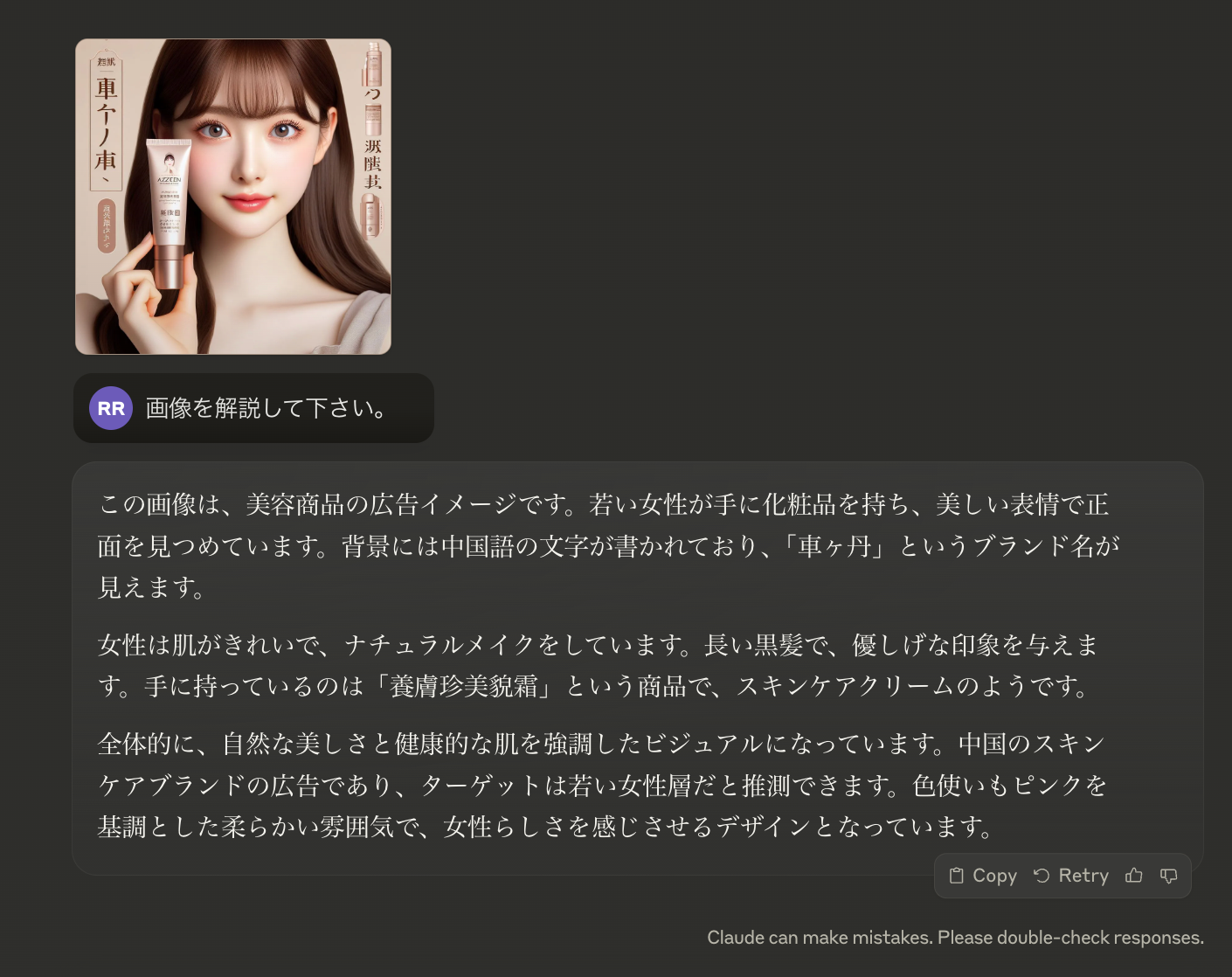

画像認識の視界が良好に

GPT-4oは画像全体の構成や画像内の要素を解説する回答をするなという印象を受けました。他の画像でも試したのですが、画像内に映っているもの一つひとつを丁寧に解説するので、これがデモ動画で見た「画像を認識して回答を生成し、音声でリアルタイムに返す」ことの実現に繋がっているのであろうと思います。

例えば、Claude 3のOpusモデルも、GPT4も人物や文字が画像内の「どこ」に配置されているかは記載されていませんが、GPT-4oは「画像の中心に女性がいる」「チューブにはブランド名が書かれている」「文字は縦書き」など、目を瞑って回答を音声を聞いたとしてもより画像がイメージできます。この点が教育面でも福祉面でも応用が出来そうなので、今後のモデルのアップデートも楽しみです。

とはいえ、中国語の文字を日本語であると回答しているハルシネーションが起きていることと、日本語に画像認識レベルは実際に触ってみて今後の活かし方を考えてみる必要がありそうです。

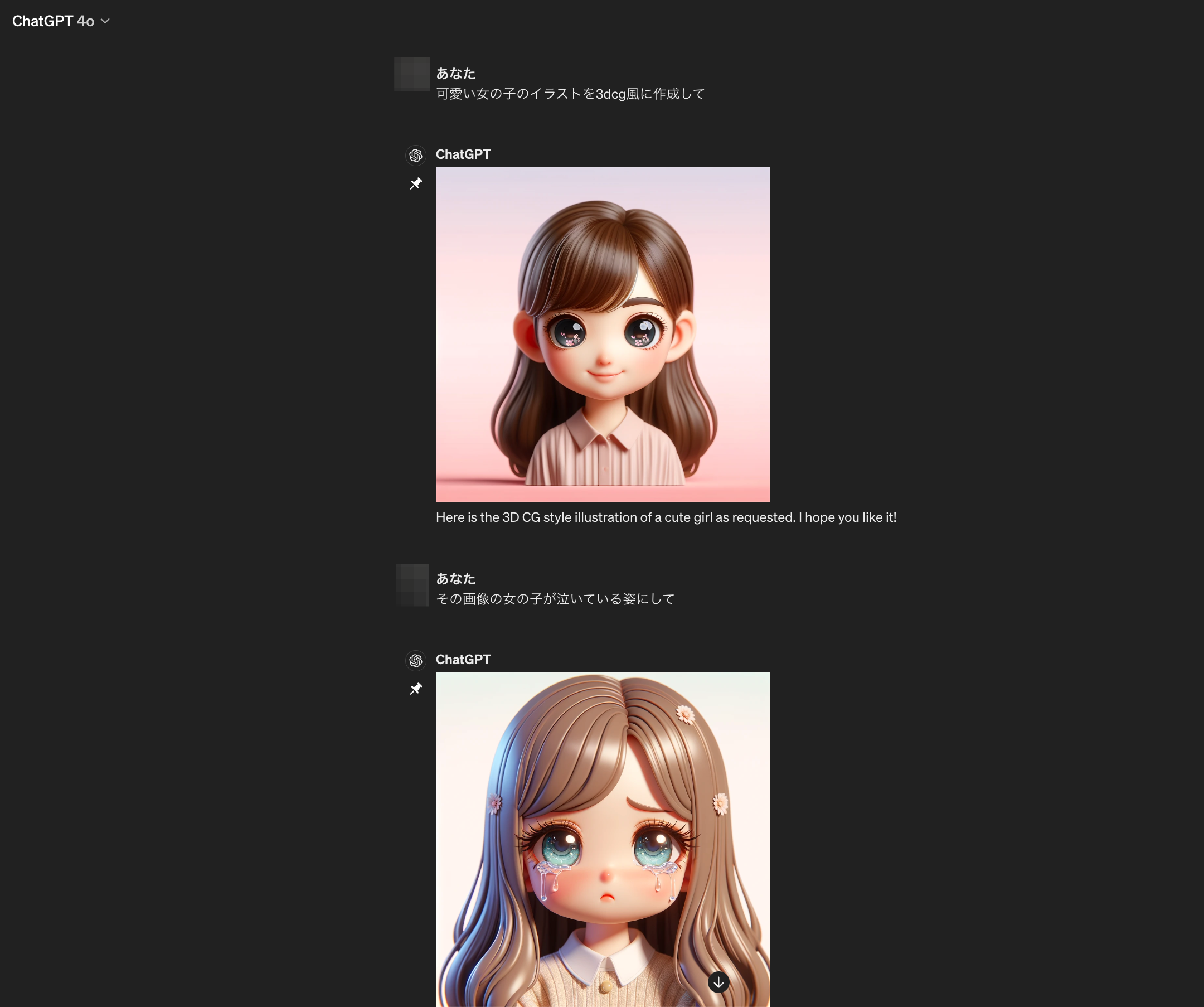

画像生成が細かい指示も反映される

画像生成速度も体感的には速くなっていますが、何より作成後の修正がより指示通りに反映されるようになっているようです。

試しにざっくりとした指示を日本語でしてみましたが、割と指示通りに実現しています。

画像生成や生成後の画像修正には本来パラメータの調整等が必要なのですが、自然言語での指示でこれほどの修正能力...そして何よりその速度に驚きました。プロンプトをこだわると公式ドキュメントと同じクオリティは実現できそうです。

圧巻のテキスト生成速度

Claude 3 Opusモデルよりも賢い性能でこんなにも速く回答を生成できるのかと1時間くらい楽しんでしまいました。

性能評価的にOpusモデルよりそこまで大きく差があるわけではないですが、速度は圧倒的に異なるのでまた癖になってしまいそうです。文脈理解もできるので、短いシンプルなプロンプトでも丁寧に回答してくれるので、無料ユーザーの方が久々に利用したら違いを味わえて楽しめると思います。色々なAI活用のアイディアが生まれる日が楽しみです。

デモ動画にあるようにデスクトップAppとリアルタイムの音声を楽しみたいので2週間以内の実装を待機しつつ、APIで何ができるか色々と模索してみます。

AIによるまとめ

OpenAIの最新フラグシップモデルGPT-4oは、マルチモーダル対応とリアルタイム性の高さから、これまでにない自然な対話体験を実現しています。音声や画像の入出力に対応し、人間の会話レベルで応答できるのが大きな特徴です。

GPT-4oの登場により、教育、医療、クリエイティブなど、さまざまな分野で革新的なアプリケーションが生み出される可能性があります。リアルタイム翻訳や、デスクトップアプリを通じた作業支援なども実現しています。

一方で、GPT-4oの性能評価では、一部の課題も指摘されています。今後さらなる高度化が期待されるとともに、倫理的な課題への対応なども重要になってくるでしょう。

人工知能の新たな地平を切り拓いたGPT-4oの行方に、世界中から大きな注目が集まっています。OpenAIのCEOサムアルトマンも語るように、GPT-4oを通じて人工知能の可能性が最大化される時代が到来したのかもしれません。

最後に

弊社では、AIを活用したマーケティングやDXのご相談を承っておりますので、ご興味がある方はぜひご連絡ください。